Der ultimative Anfängerleitfaden zu Midjourney 2025: V7 ist endlich da!

Inhaltsverzeichnis

Elf Monate geduldig warten, hunderte Beta-Prompts testen – und plötzlich liegt die wohl kreativste Bild-KI unserer Zeit vor uns. Im Folgenden erzähle ich dir aus erster Hand, wie ich Midjourney V7 seit der Alpha benutze, warum der Draft Mode mein Budget schont, welche Prompt-Formeln wirklich funktionieren und weshalb du Discord zwar noch lieben, aber nicht mehr zwingend brauchen wirst.

Mehr brauchst du für die ersten Ergebnisse nicht. Discord kannst du optional dazuschalten – dazu später mehr.

V7 – was ist neu?

Draft-Mode

Ideen-Turbo für kreatives Arbeiten

- Bis zu 10× schneller als Standard-Workflow

- 50 % weniger GPU-Kosten

- Perfekt für Mood-Boards, Pitch-Decks & Blitz-Brainstormings

Voice-Control

Sprich dein Bild einfach an

- „Mach den Himmel dramatischer“ → sofortiges Update

- Funktioniert überraschend gut auf Deutsch

- Keine umständliche Parameter-Gymnastik mehr

Omni Reference

Konstante Charakter-Kohärenz

- Porträt hochladen, –cw 0 setzen

- Kleidung, Pose & Mimik bleiben stabil

- Spürbar konsistente Szenenfolgen

Personalisierungs-Engine

Dein Style, smart optimiert

- Nach ~200 bewerteten Bildern lernt V7 deinen Geschmack

- Automatische Gewichtung deines persönlichen Stils

- Jederzeit abschaltbar mit

--pn none

Video-Funktion (Beta)

Standbild → 5-Sekunden-Clip

- Low-Motion oder High-Motion auswählbar

- Aktuell bis 480 p, 4 K-Upscaler geplant

- Erweckt deine Kreationen zum Leben

Was ist Midjourney überhaupt?

Midjourney ist ein KI-Text-zu-Bild-Generator. Auf der Website nennt das selbstfinanzierte Labor als seine Mission die Erforschung neuer Denkmedien und das Streben nach einer Erweiterung der Grenzen menschlicher Vorstellungskraft.

Öffnest du die Imagine Bar, wirst du dazu ermutigt, deine Gedanken als Prompt in Worte zu fassen.

Tippe beispielsweise: „Ein sonnenbeschienener, einsamer Leuchtturm an der rauen Küste, umgeben von schroffen Felsen und tosenden Wellen“. Drückst du die Eingabetaste, beginnt die KI damit, dein Kopfkino in vier erste Entwürfe zu übersetzen. Innerhalb von Sekunden entsteht ein kleines Bilderquartett, roh, vibrierend vor Farbe und Form, das du anschließend vergrößern, variieren oder völlig neu kombinieren kannst.

Unser Urteil zu Midjourney

Unser Urteil zu Midjourney👉 Jetzt anmelden und kostenlos ausprobieren!

Inzwischen läuft die Plattform auf Version 7. Neben Bildern generiert sie sogar kurze Videos, bietet einen Optimierungsmodus für Hände und Typografie und verarbeitet Parameter wie --q 4 für extra Detailtreue.

Wie funktioniert Midjourney?

Zum gegenwärtigen Zeitpunkt liegen uns noch nicht alle Details über das Innenleben der Midjourney-Architektur offen vor, da es sich um eine Closed-Source-Software handelt und auf einem eigenem Code basiert. Aber es gibt genug Informationen über die zugrunde liegende Technologie, um dir eine allgemeine Erklärung zu geben:

Modelle lernen, eine Verbindung zwischen Bildern und den entsprechenden Textbeschreibungen herzustellen.

Midjourney basiert auf dem ausgeklügelten Zusammenspiel zweier maschineller Lerntechnologien: großen Sprachmodellen und Diffusionsmodellen. Wenn Benutzer prompten, entschlüsselt ein großes Sprachmodell die Bedeutung jener Wörter und wandelt sie in einen numerischen Vektor um.

Diffusionsmodelle funktionieren folgendermaßen:

Ein klares Bild wird allmählich mit künstlichem „Nebel“ (Rauschen) überlagert. In der Trainingsphase entfernt nun das Modell effektiv den Nebel.

Jetz führen Latente Diffusionsmodelle einen Prozess aus, bei dem das trainierte KI-Modell systematisch „Nebel“ entfernt. Dadurch entsteht schrittweise ein neues Bild, das den Inhalt der ursprünglichen Anweisung visuell repräsentiert. Der Lernprozess ist im Gange!

Jede neu geschaffene Bildkomposition sowie jegliches Feedback, das das System empfängt, dient der fortlaufenden Verfeinerung seiner bildschaffenden Kapazitäten und des Verständnisses für die Intentionen der Nutzer.

Midjourney auf eigenem Discord Server – lohnt sich das noch?

Seit August 2024 spielt sich die Midjourney-Magie nicht mehr im dichten Stimmengewirr tausender Discord-Channels ab, sondern in einem schlanken, eigenen Web-Interface, das Discord quasi zum nostalgischen Anhang degradiert.

Öffne midjourney.com, melde dich mit deinem Google-Konto an – und noch ehe du blinzeln kannst, liegt ein aufgeräumtes Kreativ-Studio vor dir: kein Rollen-Gefummel, keine #newbie-Schlachten, nur eine klare Arbeitsfläche, Drag-and-Drop-Uploads für Referenzbilder und ein Ordnersystem, das deine Projekte perfekt sortiert.

Hinzu kommen exklusive Werkzeuge, die es auf Discord nie gab – ein mehrlagiger Editor, der In- und Out-Painting beherrscht, eine Voice-Control, die natürlich gesprochene Korrekturen versteht, und ein superschneller Draft-Modus für Ideen-Skizzen.

Die Bildqualität ist identisch, der Workflow jedoch um Lichtjahre flüssiger: Zoom, Maskieren, Weiterzeichnen – alles läuft direkt im Browser. Discord hat zwar nach wie vor seine Community und ein paar Puristen schwören auf die Slash-Commands, doch wer einfach nur zügig ein paar Bilder (oder kurze Videos) erzeugen will, findet in der Web-App das zeitgemäßere, elegantere Zuhause.

Warum trotzdem einen eigenen Discord-Server für Midjourney einrichten?

Du kannst jederzeit zwischen Website und Discord wechseln – aber die Organisation und Privatsphäre, die ein eigener Server bietet, bekommst du nirgendwo anders.

- Auf meinem eigenen Server gehen meine Bilder nicht in der Masse unter, anders als auf dem Hauptserver von MJ Discord.

- Ich richte Räume für verschiedene Kategorien ein, wie Close-Ups, Porträts oder Abstraktes.

- Du und deine Freunde könnt gleichzeitig in einem Voice-Chat sitzen, Spiele spielen und euren eigenen privaten Midjourney-Stream laufen lassen.

- Ich wechsle bei Bedarf zwischen meinem eigenen Server und dem Hauptserver von MJ Discord, um Inspirationen zu sammeln oder Hilfe zu suchen.

- Du kannst gezielt Personen zu deinem Server einladen (Geschäftspartner o. Kunden).

Und so geht’s

Zunächst benötigen wir ein Konto:

Registriere dich einfach auf der Hauptwebsite, um loszulegen.

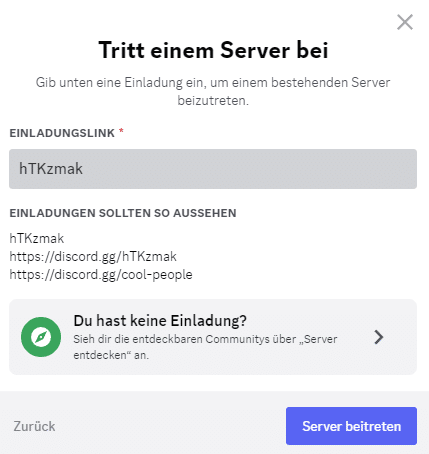

Trete dem Midjourney-Discord-Server bei:

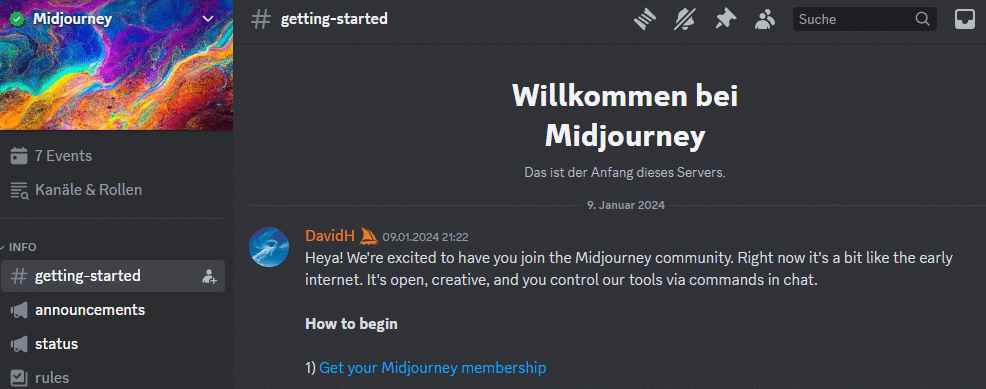

Du findest den Zugang auf der offiziellen Midjourney-Website. Dafür einfach die Schaltfläche „Join the Beta“ klicken oder direkt über den Link des Servers darauf zugreifen.

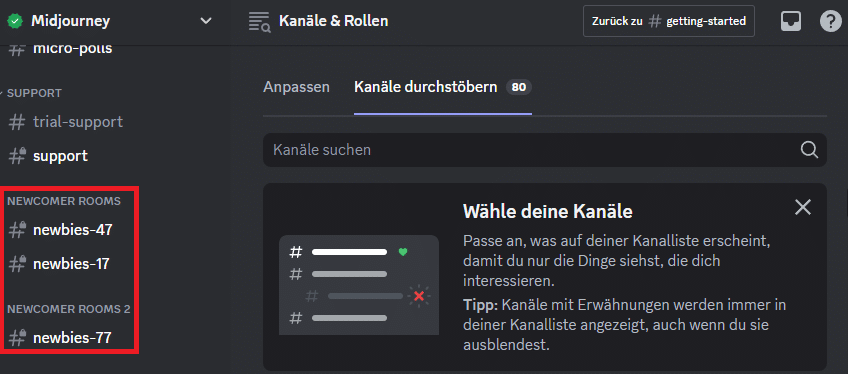

Suche dir einen Newbie-Channel:

Sobald du an Bord bist, wird dir eine Reihe von Kanälen (#) auffallen. Wenn du gänzlich neu auf der Plattform bist, beginne am besten mit den Kanälen der „Neulinge“ Klassifizierung – dabei handelt es sich um befehlsfreundliche Zonen, welche speziell auf Anfänger zugeschnitten sind.

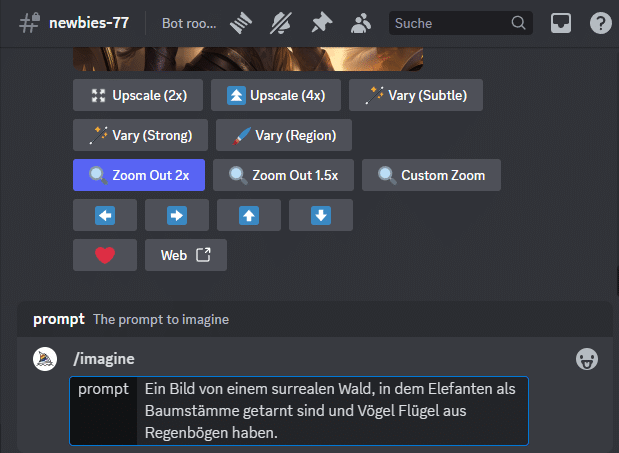

Befehle erteilen:

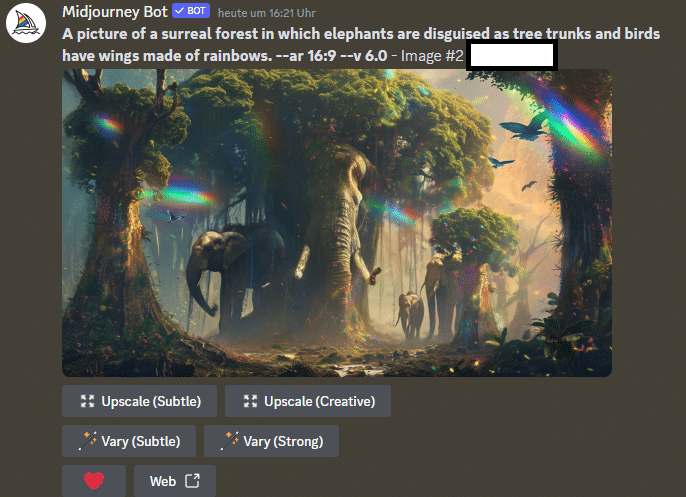

Um den Bildgenerierungsprozess zu starten, fordere nun den Bot mit dem Befehl „/imagine“ auf, gefolgt von deinem geplanten Bild (Prompt) mit der Erstellung anzufangen;

Zum Beispiel: „Ein Bild von einem surrealen Wald, in dem Elefanten als Baumstämme getarnt sind und Vögel Flügel aus Regenbögen haben.“

Interagiere mit der Ausgabe:

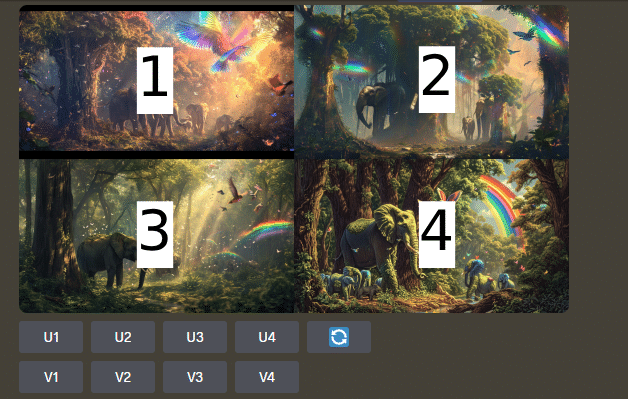

Innerhalb weniger Sekunden werden dir mehrere Darstellungen des gewünschten Bildes in Form eines 4×4-Bildrasters präsentiert.

Nun hast du die Qual der Wahl. Für welches Bild entscheide ich mich?

Die Schaltflächen direkt unterhalb des Bildes werden dich höchstwahrscheinlich erstmal irritieren, aber es ist wirklich recht simpel zu verstehen.

Wobei U1U2U3U4 die Bildauswahl vermittelt und V1V2V3V4 eine entsprechende Bildvariation darstellt.

U = Upscaling (in der Größe 1024 x 1024 Pixel) bei einem Seitenverhältnis von 16:9

V = Variation (Ein neues Raster mit vier Variationen wird erstellt, das den allgemeinen Stil und die Zusammensetzung des ausgewählten Bildes beibehält.)

Midjourney V7 Mega-Guide 2025

Alle wichtigen Features, Tricks & Geheimnisse der neuesten Version – verständlich erklärt

Natürliche Sprache statt Keyword-Chaos

Endlich verstehen sich Mensch und Maschine! Weg mit den steifen Keyword-Listen, tippe einfach in deinem ganz natürlichen Ton, was du siehst, hörst oder fühlst – und Midjourney setzt es für dich um.

Heute schreibst du: "Eine elegante Frau im roten Abendkleid flaniert durch die leuchtenden Gassen einer Großstadt bei Nacht"

🎯 So machst du's richtig:

- Erzähl Geschichten: "Ein alter Leuchtturmwärter blickt nachdenklich bei Sonnenuntergang aufs Meer"

- Nutze Gefühle: "Ein Kind staunt fasziniert über fallende Schneeflocken"

- Sei poetisch: V7 versteht sogar "melancholisch", "verspielt" oder "majestätisch"

- Kontext hilft: "In der Abenddämmerung" schlägt "--style dramatic"

Draft Mode – Zehnmal schneller zum perfekten Bild

Der Draft Mode ist V7s absolute Geheimwaffe. Zehn mal schneller bei halben GPU-Kosten – perfekt für Ideenentwicklung ohne Budgetsorgen!

🚀 Der perfekte Workflow:

- Schritt 1: Draft Mode aktivieren (Button im Web oder --draft in Discord)

- Schritt 2: 5-10 Variationen in Sekunden testen

- Schritt 3: Mit "Enhance" das beste Bild in voller Qualität rendern

- Schritt 4: Optional hochskalieren für 4K+ Auflösung

⚡ Wofür Draft Mode perfekt ist:

- Brainstorming mit Kunden oder Teams

- Schnelle Konzept-Validierung

- Storyboard-Entwicklung

- Style-Experimente ohne Risiko

Voice Control – Sprechen statt tippen

Zum ersten Mal in der KI-Geschichte: Erstelle und bearbeite Bilder nur durch Sprechen! V7s Voice Control versteht natürliche Sprache in Echtzeit – sogar auf Deutsch.

🎤 So funktioniert's:

- Aktivieren: Draft Mode → Mikrofon-Symbol klicken

- Grundprompt: "Ein majestätischer Drache fliegt über eine mittelalterliche Stadt"

- Anpassungen: "Mach den Himmel dramatischer", "Füge mehr Rauch hinzu"

- Sprachen: Deutsch, Englisch, Französisch, Spanisch, Italienisch

🔥 Warum das alles verändert:

- Kreativer Flow bleibt ungebrochen

- Schneller als Tippen

- Natürlicher Umgang mit komplexen Änderungen

- Perfekt für Präsentationen und Workshops

Omni Reference – Endlich konsistente Charaktere

Das größte Problem der KI-Bildgenerierung ist gelöst: Konsistenz! Setze beliebige Personen, Objekte oder Kreaturen in völlig neue Szenen – und sie bleiben erkennbar.

🎨 Was du damit machen kannst:

- Geschichten erzählen: Dein Protagonist in verschiedenen Szenen

- Markenidentität: Dein Logo oder Maskottchen überall

- Haustier-Fantasy: Dein Hund als Superheld oder Pirat

- Produktdesign: Dein Auto-Konzept in verschiedenen Umgebungen

- Architektur: Dein Gebäude zu verschiedenen Tageszeiten

⚙️ So richtest du's ein:

- Im Web: Bild einfach in Omni Reference-Bereich ziehen

- In Discord: --oref [BILD-URL]

- Gewichtung: --ow 300-500 für beste Balance

- Für maximale Ähnlichkeit: --ow 800+

Personalization – Dein persönlicher KI-Künstler

V7 lernt deinen Geschmack! Das System merkt sich automatisch, was dir gefällt und liefert Bilder, die genau deinen Vorstellungen entsprechen. Keine endlosen Parameter-Experimente mehr.

🎯 So aktivierst du's – Schritt für Schritt:

- Schritt 1: Gehe zu midjourney.com/rank-v7

- Schritt 2: Bewerte 200 Bildpaare (dauert nur 8-12 Minuten)

- Schritt 3: Aktiviere mit --p oder P-Button im Web

- Schritt 4: Genieße treffsichere, personalisierte Ergebnisse!

🧠 Was das System über dich lernt:

- Farbvorlieben: Welche Farbpaletten dir gefallen

- Kompositionsstil: Zentral vs. dezentral, symmetrisch vs. dynamisch

- Licht-Präferenzen: Dramatisch vs. soft, warm vs. kalt

- Detail-Level: Minimalistisch vs. detailreich

- Mood-Tendenz: Fröhlich, melancholisch, mystisch, etc.

Video Generator – Von Bild zu bewegtem Meisterwerk

Revolutionär: Verwandle jedes Midjourney-Bild in einen 5-Sekunden-Clip! Der V1 Video Generator macht aus statischen Bildern lebendige Kunstwerke.

🎬 Das kann der Video Generator:

- Low Motion: Subtile Bewegungen (Haare im Wind, sanfte Kamera, Augenlidbewegung)

- High Motion: Action-Sequenzen (Explosionen, schnelle Bewegungen, Fahrzeuge)

- Auto Mode: KI entscheidet basierend auf Bildinhalt

- Manual Mode: Du bestimmst die Bewegung per Prompt

- Verlängerbar: Bis zu 4x erweitern (maximal 21 Sekunden)

- Auflösung: Aktuell 480p (4K Upscaler kommt bald)

💰 Was es kostet:

- Basic-Plan: Circa 25 Videos pro Monat

- Standard-Plan: 15 Stunden Fast + unbegrenzt Relax

- Pro-Plan: 60€/Monat = unbegrenzte Videos im Relax Mode

- Video-Relax: Nur für Pro+ Mitglieder

Neue V7 Parameter – Experimentelle Power-Features

🔬 Die komplett neuen V7 Parameter:

- --exp 15-50: Experimentelle Details & Texturen (Sweet Spot: 25-30)

- --weird 0-3000: Endlich zurück! Für völlig unkonventionelle Ergebnisse

- --q 4: Neue Quality-Stufe für maximale Details (aber 4x teurer)

- --chaos 0-100: Komplett überarbeitet für bessere Variation

- --raw: Vereinfachte Version von --style raw

⚡ Clevere Kombinationen:

Experimentelle Details + leichte Verrücktheit + moderate Stilisierung + Kinoformat + hohe Qualität

💡 Parameter-Strategien für verschiedene Zwecke:

- Fotorealismus: --raw --q 2 --stylize 50

- Künstlerisch: --exp 40 --stylize 300 --weird 100

- Architektur: --raw --exp 20 --q 2

- Fantasy/Sci-Fi: --exp 35 --weird 150 --stylize 200

Häufige Stolperfallen vermeiden – Troubleshooting Guide

⚠️ Die Top 7 V7 Fehler (und wie du sie vermeidest):

- Personalization übersprungen: Ohne Ranking verlierst du 60% der V7-Power → Nimm dir die 10 Minuten!

- Draft Mode ignoriert: Unnötige Geld- und Zeitverschwendung → Immer erst draften

- Parameter-Overkill: V7 braucht 80% weniger Parameter als V6 → Weniger ist mehr

- Voice Control ungenutzt: Das beste Feature bleibt unentdeckt → Einmal ausprobieren!

- Alte V6 Prompts kopiert: V7 versteht natürliche Sprache → Schreib wie ein Mensch

- Omni Reference falsch gewichtet: --ow zu hoch oder niedrig → Sweet Spot 300-500

- Video-Prompts wie Bild-Prompts: Videos brauchen Bewegungsverben → "slowly", "gently"

• Prompt zu lang? → In zwei natürliche Sätze aufteilen

• Ergebnis unscharf? → --q 2 hinzufügen

• Stil inkonsistent? → Personalization aktivieren + --p verwenden

• Zu langsam/teuer? → Draft Mode für Experimente nutzen

• Video ruckelt? → Manual Mode statt Auto Mode probieren

🩺 Diagnose-Checkliste für schlechte Ergebnisse:

- ✅ Personalization aktiviert und mindestens 200 Rankings gemacht?

- ✅ Prompt in natürlicher Sprache statt Keywords geschrieben?

- ✅ Zu viele Parameter verwendet? (Weniger ist oft mehr in V7)

- ✅ Richtige Aspect Ratio für den Zweck gewählt?

- ✅ Bei Videos: Bewegungsverben im Prompt verwendet?

Ausblick 2025/2026 – Was kommt als Nächstes?

🚀 Bestätigte Features für die nächsten 12 Monate:

- 4K Video Upscaling: Bereits in Beta-Tests, Launch Q4 2025

- NeRF-basierte 3D: Immersive 3D-Umgebungen aus 2D-Prompts (Q1 2026)

- Text-to-Video: Vollständige Video-Generierung ohne Startbild (Q2 2026)

- API Access: Für Entwickler und Enterprise-Kunden (Q4 2025)

- Extended Videos: Über 21 Sekunden hinaus, bis zu 2 Minuten (Q1 2026)

- Multi-Character Consistency: Mehrere konsistente Charaktere in einer Szene

🔮 Gerüchte & gut informierte Spekulationen:

- Version 8: Entwicklung läuft parallel, komplett neue Architektur

- Real-time Generation: Instant-Bilder ohne Wartezeit

- VR/AR Integration: Native Unterstützung für VR-Headsets

- Audio-to-Image: Bilder aus Musik und Klängen erstellen

- Collaborative Mode: Mehrere Nutzer arbeiten gleichzeitig

- AI Director Mode: KI plant und erstellt komplette Bildserien

Weitere Tipps & Tricks

Der Sweet Spot: Standard-Plan

Wenn du vor der Entscheidung stehst, ein Midjourney-Abonnement zu wählen, gibt es im Wesentlichen zwei Einsteiger-Optionen: Ein Abonnement für 10 Dollar pro Monat und eines für 30 Dollar.

Hier ein wichtiger Tipp: Skippe das 10-Dollar-Abo. Es mag auf den ersten Blick attraktiv erscheinen, aber du wirst feststellen, dass es sich kaum lohnt.

- Basic-Plan

- 200 Bilder sind schneller weg, als du „/imagine“ tippen kannst.

- Zusatzpakete: 4 € pro Fast-Stunde → Bildpreis steigt von 0,05 € auf 0,067 €.

- Kein Relax-Modus: Ist das Guthaben leer, steht die Produktion still.

- Standard-Plan

- 4,5-fach mehr Schnellgenerierungen.

- Unlimited Relax: Wartezeit 1–8 Min., aber endlose Experimente gratis.

- Kein Relax-Modus: Ist das Guthaben leer, steht die Produktion still.

Schnappe dir also direkt das 30er-Abo. Der größte Vorteil besteht darin, dass du Zugang zum /Relax-Modus erhältst. Deine Bilder werden zwar langsamer generiert, dafür aber komplett kostenlos.

So generierst du Midjourney-Eingabeaufforderungen mit ChatGPT

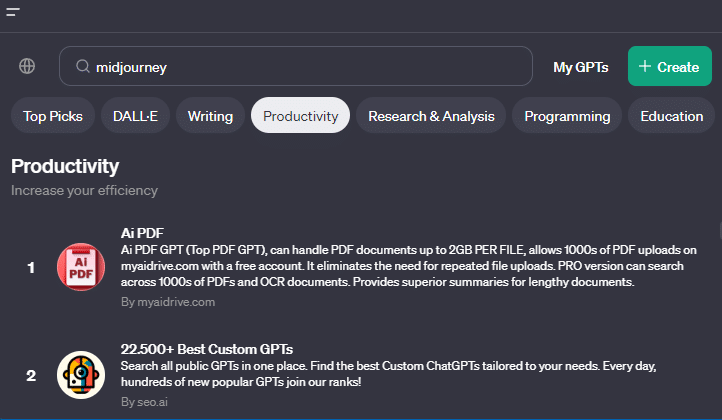

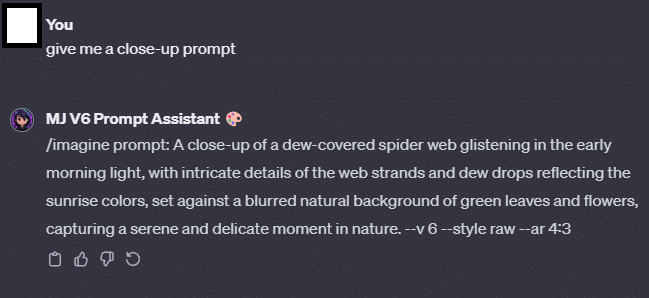

Es ist doch erstaunlich mit welcher Wucht ChatGPT Anfang 2022 eingeschlagen ist. Seit neuestem gibt OpenAI uns Plus-Mitgliedern eine weitere Möglichkeit an die Hand, um die Produktivität noch weiter zu steigern. Mit einem Store!

Der Store präsentiert eine umfangreiche Sammlung von GPT-Modellen, die sowohl von Partnern als auch von der Community entwickelt wurden. Hier kann durch eine Vielzahl an beliebten und aktuellen GPTs gestöbert werden, die in einer Community-Rangliste nach Kategorien wie DALL·E, Schreiben, Forschung, Programmierung, Bildung und Lifestyle geordnet sind.

Suche dir einfach deinen passenden Draft (eines Users) und nehme ihn als Stütze für deine gedanklichen Ausschweife 😊. Viel Erfolg!

Gratis-Stunden verdienen

Du möchtest mehr Bilder erzeugen, ohne ständig Extra-Stunden nachzukaufen – und gleichzeitig dafür sorgen, dass Midjourney deinen Geschmack besser trifft? Dann ist das Rating-System dein Joker.

So holst du dir täglich freie Fast-Stunden

- Tasks-Tab öffnen:

midjourney.com → Tasks. - Image Ranking starten: Zwei Bilder erscheinen, du klickst auf das, das dich mehr anspricht.

- Top 2 000 knacken: Wer täglich 10–15 Minuten (≈ 300 Ratings) durchzieht, rutscht fast automatisch in die Bestenliste – und kassiert eine kostenlose Fast-Hour.

Doppelte Dividende: Stil-Profil trainieren

- Nach 200 Bewertungen schaltest du Personalization frei.

- Midjourney merkt sich Farbvorlieben, Kompositionstricks, Lichtstimmungen – und wendet sie künftig automatisch an.

- Ein einziger Prompt sitzt dadurch viel häufiger beim ersten Versuch.